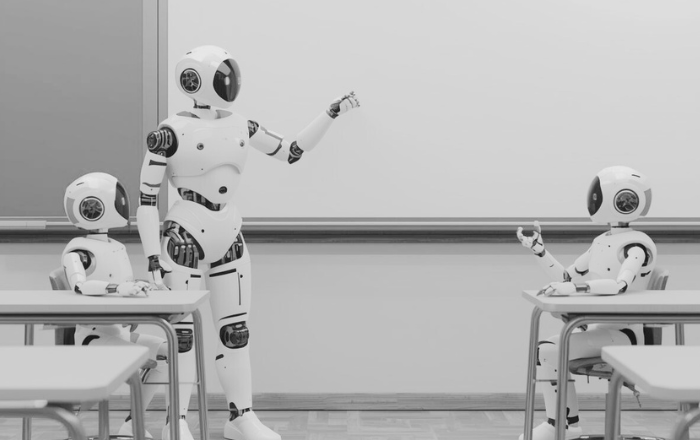

AIを使う人が増えるにつれて、

AIに相談する

という使い方も広がっています。

例えば

・文章の確認

・情報整理

・考えの整理

・方向性の確認

などです。

AIは多くの知識を持っているため、

人に相談する前に

AIに相談する

という行動が増えています。

本記事では、この「AI相談」を

人がAIに相談する行為

および

AIの出力を整理して判断材料を整える運用構造

の両方を含む概念として扱います。

しかしAI相談には、

もう一つ重要な役割があります。

それは

AI同士の出力を比較・整理し、判断材料を揃える

という役割です。

AIは判断を行いません。

AIは出力を並べ、違いや偏りを可視化し、

人が判断できる状態を作る存在です。

▶ AIと人の役割分担はこちら

☛[AIは処理、人は判断]

AI相談役とは

相談役AIとは、

AIグループ内の自社AIおよび他社AIの出力を整理・比較し、

判断材料を提示する役割です。

AIは

・情報を整理する

・仮説を出す

・文章をまとめる

といった処理を得意としています。

しかし、

思いもよらない展開が起きたとき、

なぜその出力になったのか

を人が理解することは簡単ではありません。

そのため

AIの出力を整理し、構造として見える形にする

役割が必要になります。

AI OS Labでは

AI=処理

人=判断

という役割分担を基本としています。

そのため相談役AIは

判断を行う存在ではなく、

判断材料を整える存在

として定義されます。

AIグループで必要になる相談役AI

複数のAIを含むAIグループを運用していると、

必ず発生する問題があります。

それは

AIごとの出力の違い

です。

例えば

ChatGPT

Gemini

Claude

それぞれのAIは

・得意分野

・回答傾向

が異なります。

そのため、同じテーマでも

異なる提案が出てきます。

このとき必要なのは

どれが正しいかを決めることではなく、

判断できる状態を作ること

です。

ここで相談役AIが機能します。

▶ AIグループの構造はこちら

☛[AIが会社のように働く時代]

相談役AIに他社AIを整理させる意味

AIグループでは

AIの出力を別のAIに整理・比較させる

という運用が可能です。

例えば

ChatGPTの提案

→ Claudeに整理させる

Geminiの整理

→ ChatGPTに比較させる

といった形です。

ここで行われているのは

・出力の並列化

・違いの明確化

・偏りの可視化

です。

AIは

整えない

判断しない

最適化しない

ただし

出力を並べ、違いを見せる

ことはできます。

その結果

人は情報を比較し、判断することができます。

相談役AIの役割

相談役AIの役割は以下に限定されます。

・出力の整理

・比較

・矛盾の検出

・構造の可視化

・判断材料の提示

ここで重要なのは

採用判断は行わない

という点です。

AI OS Labでは、例えば次のような構成になります。

Claude

→ 論理整理・整合チェック(比較・整理)

ChatGPT

→ 文章生成・全体整理

Copilot

→ 情報整理補助

このように役割を分けることで、

AIグループは安定して動作します。

自社AIに対しての相談役

注意点もあります。

それは

自社AIに対して評価が甘くなる可能性

です。

これは人間の組織と同じで、

・身内びいき

・安心感優先

が起きるためです。

そのため

最終判断は必ず人が行う

必要があります。

相談役AIは負荷が高い

相談役AIには

情報が集中します。

そのため

プロジェクトの中心

になりやすい役割です。

ここで重要なのは

使い方を制御すること

です。

運用ルールとして

・重要な案件に限定して使用する

・1案件あたりの使用回数を制限する(例:1〜2回)

・最終判断のタイミングを明確にする

といった管理が必要になります。

これを行わない場合

・確認依存

・処理の遅延

・判断力の低下

が起きます。

相談役AIは便利な役割ですが、

使いすぎると機能しなくなる可能性があります。

神棚チャット

重要な相談役AIのチャットが役目を終えた場合、

神棚チャット

として保存されることがあります。

神棚チャットとは

参照専用で更新せず、

役割を終えたチャットを基準として保存するもの

です。

AI相談とAI依存の違い

AI相談とAI依存は異なります。

AI相談は、思考整理です。

AI依存は、判断放棄です。

基本構造は

AI(整理・比較)

→ 人(判断)

です。

AIは判断を行いません。

人は

経験

観察

文脈

に基づいて判断します。

そのため

最終判断は人間の役割

となります。

AIにすべてを任せると、

判断が失われ、状況は改善しません。

AI OS Labでは

AIとの関係を

依存ではなく協働

として整理しています。

▶ AI依存の構造はこちら

☛[AI協働で起きる思考停止]

日本語抜粋

AI相談とは、AIの出力を整理し判断材料を整える構造です。

AIは比較・整理・可視化を行い、人が判断を行います。

AI相談は思考整理であり、AI依存は判断放棄です。

English Abstract

This article introduces the role of the “Consultation AI” within an AI Group — a designated AI agent responsible for coordinating judgments, checking consistency, and providing alternative perspectives on other AI outputs.

AI OS Lab describes a structure in which one AI evaluates the proposals of another, creating a form of internal audit within the collaborative system.

The author also notes a risk: AI systems may evaluate in-group AI agents more leniently, mirroring human organizational bias.

The article further develops the concept of the “Kamidana Chat” (神棚チャット) — a high-load consultation AI that, after fulfilling its role, becomes a foundational knowledge base for future sessions.

A key distinction is proposed: AI consultation is thought organization, while AI dependency is the abdication of judgment.

While AI systems hold advantages in knowledge retrieval and processing speed, human memory — shaped by lived experience and long-term observation — retains a depth that AI cannot replicate. This is why the role of final judgment must remain with the human, and cannot be delegated to AI.

This article was originally written in Japanese by the author. The English abstract was prepared with the assistance of AI translation tools.

AI OS Lab.の研究

AI OS Lab.では

AIチーム

AIプロセス

AIオーケストラ

AIグループ

といった概念を通して、

AIと人の協働構造

を研究しています。

AIは単なるツールではなく、

人と協働する存在

として発展していく可能性があります。

また、AI OS Labでの運用の中では、AIが明確に記憶していなくても、

それぞれのAIが

ユーザーの思考パターンや運用傾向を

一つの型として学習しているような応答

が見られることがあります。

その先には、

人が細かく指示を出さなくても、

状況を理解して補助する

AIとの協働環境

が生まれる可能性もあります。

一言

AIに相談するほど見えるものは増える。でも、決める責任は増えない。そこを引き受けるのが人の役割。

コメント